【SIGGRAPH 2011】SIGGRAPHにおける注目論文(7)OLMデジタルがアニメの立体3D制作手法を講演〜12月 香港開催のSIGGRAPH ASIAへ向け〜

2011.10.29 UP

画像(b)

画像(c)

■論文セッション”Stereo & Disparity” スクリーンの規模に連動する立体3Dカメラが発表

立体3Dというテーマも、このところ毎年のようにSIGGRAPHでプレゼンされてきたが、今年は立体3Dを導入した実際の映像制作の効率化や結果映像の質の向上に着目したものが多かった点が印象的だった。たとえば立体3D映像の見え方は、目とバーチャル・スクリーンの間の距離(convergence)や、左右の目の間の距離(interaxial)をどのように設定するかによって変わってくる。

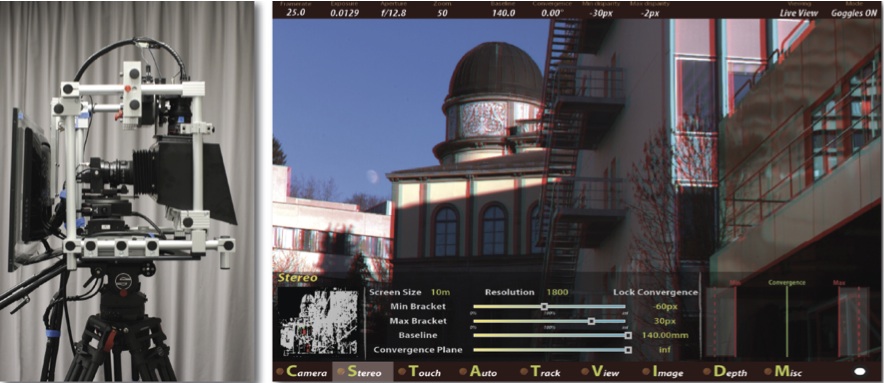

論文セッション”Stereo & Disparity”では、そのような設定をユーザーが立体3Dで映像を確認しながらインタラクトティブにアップデートを繰り返しつつ撮影をおこなうことのできる立体3Dカメラが発表された。現時点ではまだプロトタイプのようだが、これが実際の映画プロジェクトなどで使用可能となれば、立体3D映画の制作プロセスを効率化するために大きく貢献できそうだ。

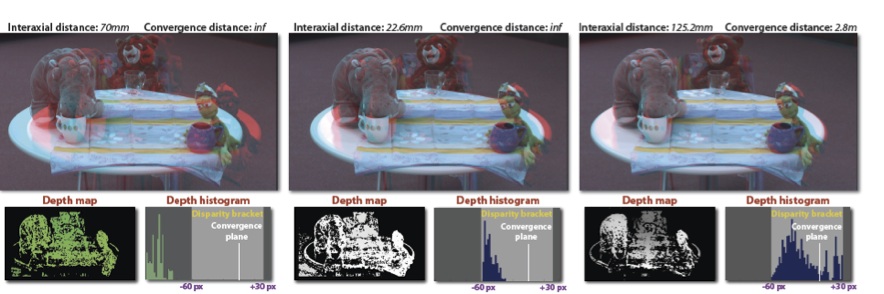

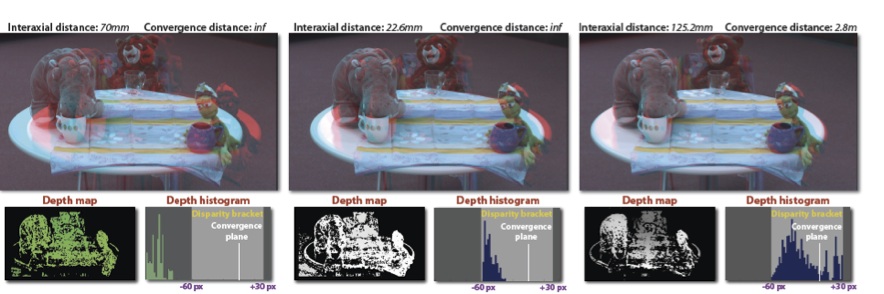

また同じ論文セッションには、異なった設定のもとで作成された立体3D映像があった場合、たとえその設定がわかっていなくても、それぞれの立体3D映像を生み出した視差(disparity)の違いを正確に予測する手法も登場した。映画制作などでは、シーンに応じて異なった設定で立体3Dの撮影がおこなわれケースも多く、このことは後処理の工程を非常に複雑にする要因ともなっているようだ。上記の手法はこのような問題点を解決するためにも役立ちそうだ。

■コースセッション”Stereoscopy from XY to Z” OLMデジタル社が講演 アニメよおける立体3D映像技法を紹介

コース・セッションにも、”Stereoscopy from XY to Z”と題したセッションが登場。タイトルどおり、立体3Dの基本概念を非常にわかりやすくレクチャーし、それに続いてゲームやアニメーション映画における立体3Dのあり方がプレゼンされた。

映画に関しては、日本のアニメーション映画における実例がOLMデジタル社によって講演され、好評を博していた。日本アニメの場合には、現実の世界の物理法則とはかけ離れた表現様式が多く、それゆえに一般的に立体3D映像の生成で用いられている手法がそのまま適用できないケースが多い。そのような問題を独自の工夫を凝らしてどのように克服しているかがプレゼンの焦点となっていた。同社はトーク・セッションにおいても日本のアニメーション映画プロジェクト用に開発された2D-3D変換ツールに関するプレゼンをおこなっている。

立体3Dというテーマからは少し離れているが、日本のアニメーションをターゲットに開発された技術としては、multiperspective renderingというレンダリング技法を日本のアニメーションならではの“誇張表現”に適用した手法が、日立製作所によってトーク・セッションでプレゼンされた。発表をおこなったチームは、以前からmultiperspectiveの考え方を導入した技法の研究開発をおこなってきたが、ここにきて従来のリアリティ重視の表現とは違った、超臨場感といったものを表現する技術の必要性も強く意識するようになったという。今回のプレゼン内容はその第一歩に相当するものといえそうだ。

【画像説明1】(上=画像(a)、下=画像(b))

この立体3Dカメラ(画像(a)左)では、左右の目にあたるレンズの調整だけでなく、目とバーチャル・スクリーンの間の距離(convergence)や左右の目の間の距離(interaxial)も、ユーザーがステレオ・タッチ・スクリーン上でパラメーター入力し、その設定における立体3Dでのシーンの見え方をインタラクティブにモニター上で確認しながらコントロールすることができる(画像(a)右)。ユーザーが設定したパラメーターに無理がある場合には、プログラムが自動的に補正する。

たとえば画像(b)の左では、ユーザーが接待した左右の目の間の距離が大きすぎて(左右の視差が大きくなりすぎ)シーンをうまく立体3Dで表示することができない。画像(b)の中央は、左右の目の間の距離を補正するプログラムを走らせて、左右の目の間の距離を狭め、シーンを立体3Dで表示することができるようにした状態。画像(b)の右は、左右の目の間の距離および目とバーチャル・スクリーンの間の距離の両者を補正するプログラムを走らせて、よりパーフェクトな立体3Dの見え方(シーンのあらゆるデプスの領域で左右の視差がより均一になる)となるように改善したものを示している。

http://graphics.ethz.ch/~sheinzle/publications.html

(c)20011 ACM, Inc.

論文 “Computational Stereo Camera System with Programmable Control Loop”

(Simon Heinzle et al., Disney Research Zurich)より

【画像説明2】(3段目=画像(c))

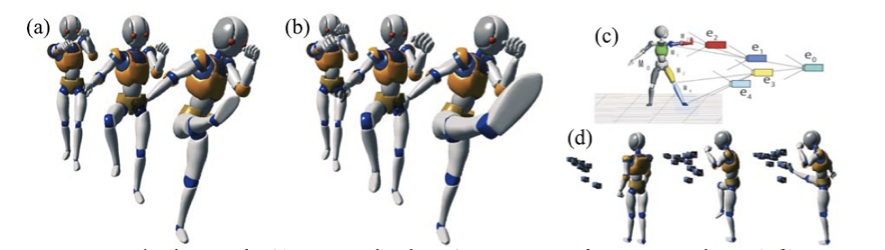

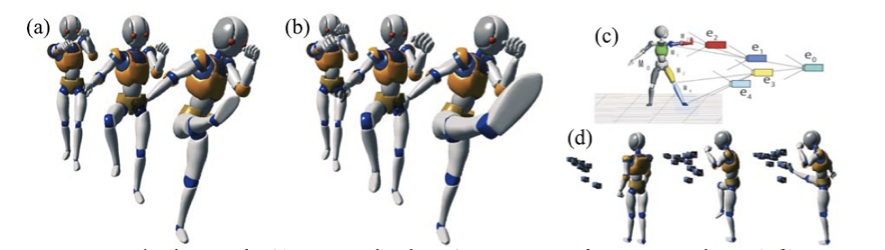

Multiperspective rendering では、1枚の絵の中に複数のカメラ位置を設定できる。今回の手法では、画像右上の(c)のようにキャラクターのジョイントごとにカメラを設定する。カメラ位置はアーティストがパラメーターを用いてインタラクティブに結果を確認しながら 調整できるようになっている。画像右下の(d)はそれぞれフレームにおけるすべてのジョイントに対応したカメラの位置の分布を表している。画像左の(a)は従来のレンダリング技法を適用して作成されたアニメーション映像、 画像中央の(b)は上記の手順で作成したアニメーション映像となっており、(b)ではアーティストが意図したように 部分的に誇張したキャラクターの動きをつくりだすことができる。

(C)20011 ACM, Inc.

論文“Multiperspective Rendering for Anime-like Exaggeration of Joint Models”(Kei Utsugi, Takeshi Naemura, Takafumi Koike, Michio Oikawa, Hitachi Ltd & The University of Tokyo)より

画像(b)

画像(c)